Žiniatinklio valdytojai jau seniai diskutavo apie robots.txt failo naudojimą, nes jis gali pasirodyti esąs stiprus įrankis, kai jis gerai parašytas arba juo galima šaudyti į koją. Skirtingai nuo kitų SEO koncepcijų, kurias galima laikyti abstraktesnėmis ir kurioms neturime aiškių gairių, „robots.txt“ failas yra visiškai dokumentuotas „Google“ ir kitų paieškos sistemų.

Jums reikia failo robots.txt

tikjei turite tam tikras savo svetainės dalis, kurių nenorite indeksuoti, ir (arba) turite užblokuoti ar tvarkyti įvairius tikrintuvus.

* kreipkitės į Richardą, kad pataisytų aukščiau pateiktą tekstą. (daugiau informacijos rasite komentaruose). Tai, ką reikia žinoti robotų failo atveju, yra tai, kad jis netaikomas įstatymui, kurio tikrintojai privalo laikytis, tai daugiau kelrodis su keliomis nuorodomis. Laikantis šių gairių paieškos sistemos gali greičiau ir geriau indeksuoti, o klaidos, slėpdamos svarbų turinį nuo tikrintuvų, galiausiai praras srauto ir indeksavimo problemas.

Robots.txt istorija

Esame įsitikinę, kad dauguma iš jūsų jau yra susipažinę su robots.txt, bet tik tuo atveju, jei apie tai girdėjote prieš kurį laiką ir nuo to laiko pamiršote, tai yra oficialiai žinomas robotų išskyrimo standartas, su kuriuo svetainė bendrauja žiniatinklio tikrintuvus ar kitus interneto robotus. Iš esmės tai yra tekstinis failas, kuriame pateikiamos trumpos instrukcijos, nukreipiančios tikrintuvus į tam tikras svetainės dalis arba toli nuo jų. Robotai dažniausiai mokomi ieškoti šio dokumento, kai jie pasiekia svetainę ir laikosi jos nurodymų. Kai kurie robotai neatitinka šio standarto, pvz., El. Pašto rinkimo, šlamšto ar kenkėjiškų programų robotai, kurie, pasiekę jūsų svetainę, neketina geriausių tikslų.

Viskas prasidėjo 1994 m. Pradžioje, kai Martijnas Kosteris sukūrė interneto tikrintuvą, kuris sukėlė blogą DDOS atvejį jo serveriuose. Reaguodamas į tai, buvo sukurtas standartas, skirtas žiniatinklio robotams nukreipti ir neleisti jiems pasiekti tam tikrų sričių. Nuo to laiko robotų failas vystėsi, jame yra papildomos informacijos ir jis gali būti naudojamas dar keliais atvejais, tačiau vėliau tai aptarsime.

Kiek jūsų svetainei svarbu „Robots.txt“?

Norėdami geriau suprasti, galvokite apie robotą.txt kaip apie tikrintuvų ir robotų kelionių vadovą. Lankytojai, kurie nėra žmonės, nuveda į nuostabias svetainės vietas, kuriose yra turinys, ir parodo, kas svarbu būti, o ne būti indeksuojamiems. Visa tai atliekama naudojant kelias eilutes txt failo formatu. Turėdami patyrusį robotų vadovą galite padidinti indeksavimo greitį ir sutrumpinti laiką, per kurį robotai pereina kodo eilutes, kad surastų turinį, kurio vartotojai ieško SERP.

Per visą laiką į robotų failą buvo įtraukta daugiau informacijos, kuri padeda žiniatinklio valdytojams greičiau tikrinti ir indeksuoti savo svetainę.

Šiuo metu daugumoje failų robots.txt yra adresas sitemap.xml, kuris padidina robotų tikrinimo greitį. Mums pavyko rasti robotų rinkmenas, kuriose buvo įdarbinimo skelbimai , pakenkti žmonių jausmams ir netgi instrukcijos, kaip mokyti robotus , kai jie tampa sąmoningi. Turėkite omenyje, kad nors roboto failas skirtas tik robotams, jis vis tiek yra viešai prieinamas visiems, kurie jūsų domenui naudoja /robots.txt. Bandydami slėpti nuo paieškos sistemų asmeninę informaciją, tiesiog parodykite URL tiems, kurie atidaro robotų failą.

Prisiregistruokite gauti išskirtinius SEO patarimus ir atvejų tyrimus

Gaukite nemokamų SEO strategijų, kurias galite naudoti norėdami padidinti savo svetainės srautą ir padidinti konversijų skaičių.

Kaip patvirtinti „Robots.txt“

Pirmas dalykas, kai turite savo robotų failą, yra įsitikinti, kad jis tinkamai parašytas, ir patikrinti, ar nėra klaidų. Viena klaida čia gali ir pridaryti daug žalos, todėl baigus failą robots.txt, būkite ypač atsargūs tikrindami, ar jame nėra klaidų. Dauguma paieškos variklių pateikia savo įrankius, kad patikrintų robots.txt failus ir netgi leidžia jums pamatyti, kaip tikrintuvai mato jūsų svetainę.

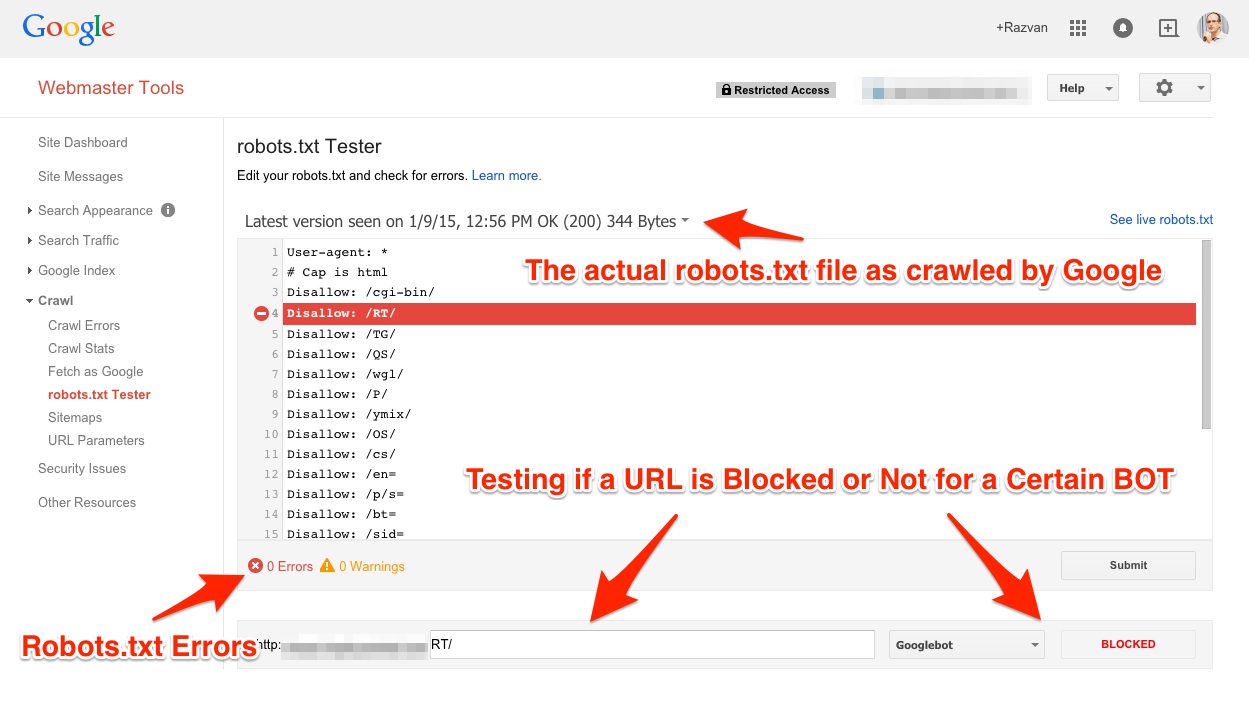

„Google“ žiniatinklio valdytojo įrankiai siūlo įrankį robots.txt , kuris nuskaito ir analizuoja jūsų failą. Kaip matote paveikslėlyje žemiau, galite naudoti GWT robotų testerį, kad patikrintumėte kiekvieną eilutę, patikrintumėte kiekvieną tikrintuvą ir kokią prieigą jis turi savo svetainėje. Įrankis rodo datą ir laiką, kai „Googlebot“ iš jūsų svetainės atnešė roboto failą, rastą HTML kodą, taip pat sritis ir URL, prie kurių neturėjo prieigos. Turi būti ištaisytos visos klaidos, kurias rado testeris, nes jos gali sukelti jūsų svetainės indeksavimo problemų ir jūsų svetainė negalėjo būti rodoma SERP.

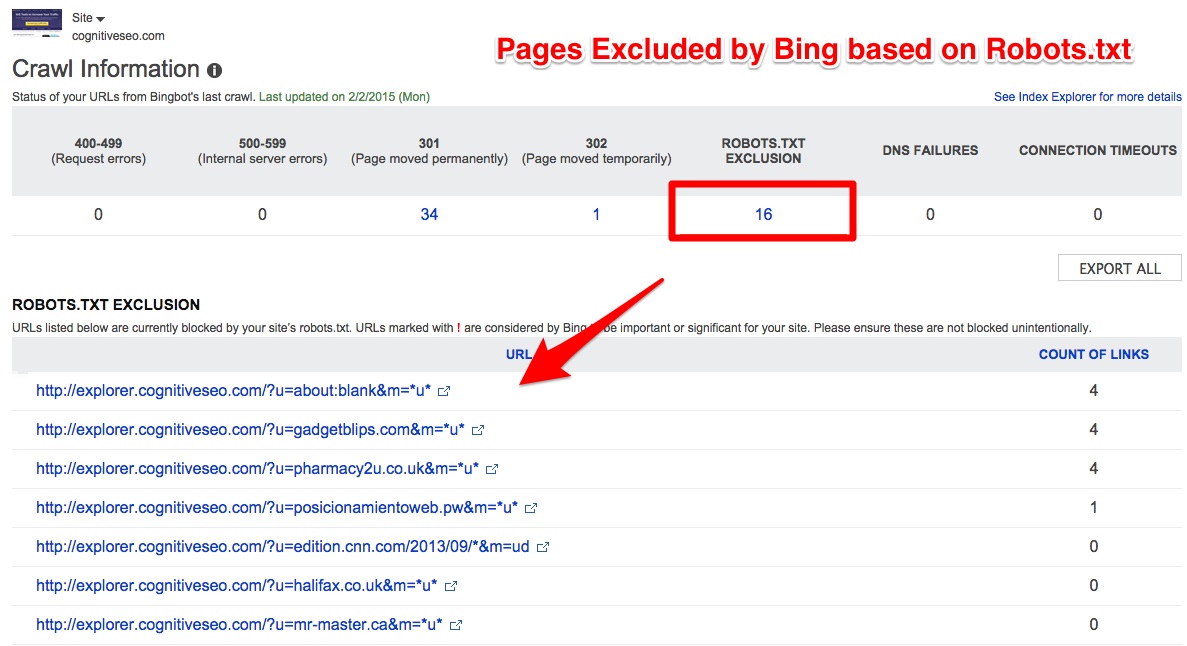

„ Bing“ pateiktas įrankis rodo duomenis, kuriuos mato „BingBot“. Gaunant taip, kaip „Bingbot“, rodomos net jūsų HTTP antraštės ir puslapių šaltiniai, kaip jie atrodo kaip „Bingbot“. Tai puikus būdas sužinoti, ar jūsų turinį tikriausiai mato tikrintuvas ir ar jis nėra paslėptas dėl klaidos robots.txt faile. Be to, galite išbandyti kiekvieną nuorodą pridėdami ją rankiniu būdu, o jei bandytojas nustato su ja susijusių problemų, jūsų robotų faile bus rodoma eilutė, kuri ją blokuoja.

Nepamirškite skirti laiko ir kruopščiai patvirtinti kiekvieną robotų failo eilutę. Tai yra pirmas žingsnis kuriant gerai parašytą robotų failą, o naudodamiesi savo turimais įrankiais tikrai turite labai stengtis padaryti čia klaidų. Dauguma paieškos sistemų teikia parinktį „gauti kaip * botą“, todėl patys apžiūrėję failą robots.txt būtinai paleiskite jį naudodami pateiktus automatinius testerius.

Neišmeskite svarbių puslapių iš „Google“ indekso

Norint įsitikinti, kad turite puikų robotų failą, nepakanka turėti patvirtintą „rob.txt“ failą. Negalime to pakankamai pabrėžti, tačiau turėdami vieną eilutę savo robotuose, blokuodami svarbios svetainės turinio dalies tikrinimą, galite pakenkti jums. Taigi, norėdami įsitikinti, kad neišskyrėte svarbių puslapių iš „Google“ indekso, galite naudoti tuos pačius įrankius, kuriuos naudojote patvirtindami failą robots.txt.

Gaukite svetainę kaip robotą ir naršykite joje, kad įsitikintumėte, jog neatmetėte svarbaus turinio.

Prieš įterpdami puslapius, kurie nepatenka į robotų akiratį, įsitikinkite, kad jie yra šiame elementų sąraše, kuris paieškos varikliams teikia mažai arba visai neturi jokios vertės:

- Kodo ir scenarijaus puslapiai

- Privatūs puslapiai

- Laikini puslapiai

- Bet kuris puslapis, jūsų manymu, neturi vertės vartotojui.

Mes rekomenduojame, kad kurdami svetainės architektūrą turėtumėte aiškų planą ir viziją, kad galėtumėte lengviau neleisti aplankų, kurie neturi jokios vertės paieškos tikrintuvams.

Kaip sekti neleistinus „Robots.txt“ pakeitimus

Dabar viskas yra vietoje, robots.txt failas yra baigtas, patvirtintas ir įsitikinote, kad nėra klaidų ar svarbių puslapių, neįtrauktų į „Google“ tikrinimą. Kitas žingsnis – įsitikinti, kad niekas neatlieka dokumento pakeitimų, jums to nežinant. Tai ne tik apie failo pakeitimus, bet ir turite žinoti apie visas klaidas, kurios atsiranda naudojant robots.txt dokumentą.

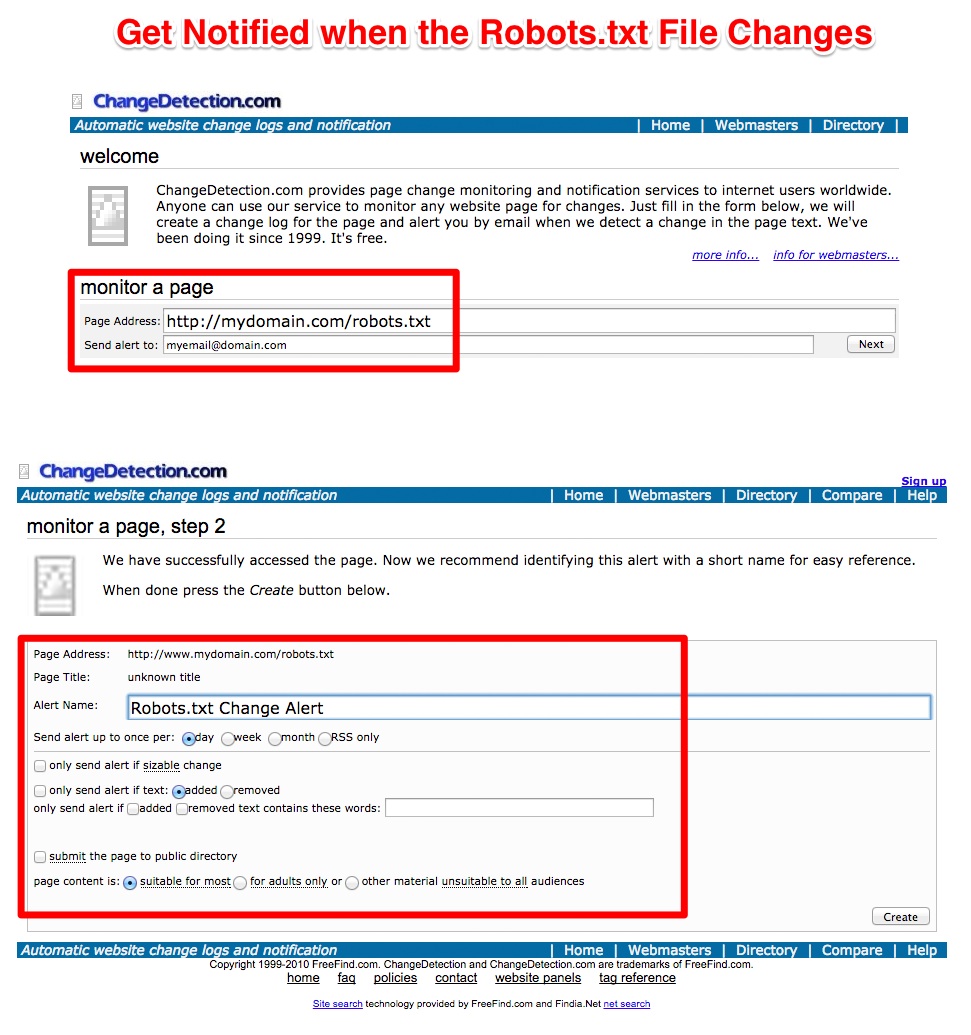

1. Pranešimai apie pakeitimų aptikimą – nemokamas įrankis

Pirmasis įrankis, kurį norime rekomenduoti, yra changetection.com . Šis naudingas įrankis stebi visus atliktus puslapio pakeitimus ir automatiškai siunčia el. Laiškus, kai juos aptinka. Pirmas dalykas, kurį turite padaryti, yra įterpti robots.txt adresą ir el. Pašto adresą, apie kurį norite būti informuoti. Kitas žingsnis yra tai, kur jums leidžiama tinkinti pranešimus. Pranešimų dažnumą ir įspėjimus galite keisti tik tuo atveju, jei buvo pakeisti tam tikri failo raktiniai žodžiai.

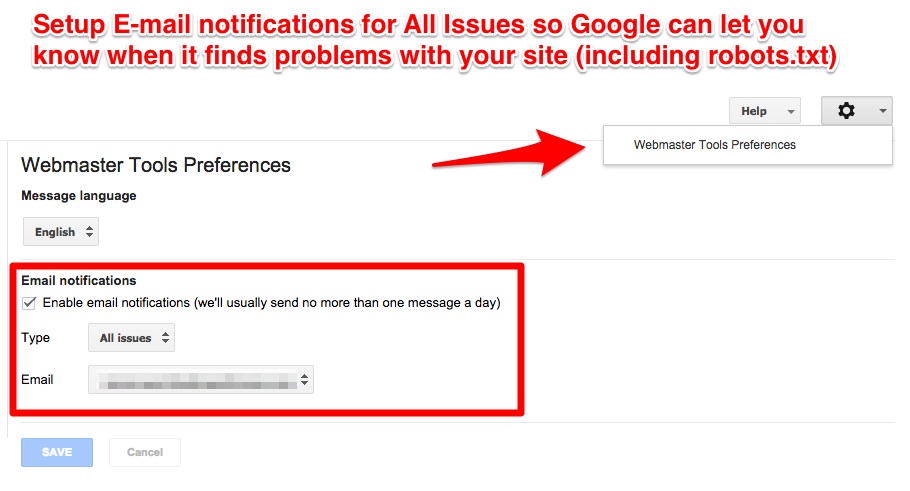

2. „Google Webmaster Tools“ pranešimai

„Google Webmaster Tools“ pateikia papildomą įspėjimo įrankį . Naudojant šį įrankį skirtumas yra tas, kad jis veikia siunčiant jums pranešimus apie bet kokias klaidas jūsų kode kiekvieną kartą, kai tikrintuvas pasiekia jūsų svetainę. Robots.txt klaidos taip pat yra stebimos ir kiekvieną kartą, kai pasirodys problema, gausite el. Laišką. Čia yra išsamus naudojimo vadovas, skirtas nustatyti „ Google Webmaster Tools Alerts“ .

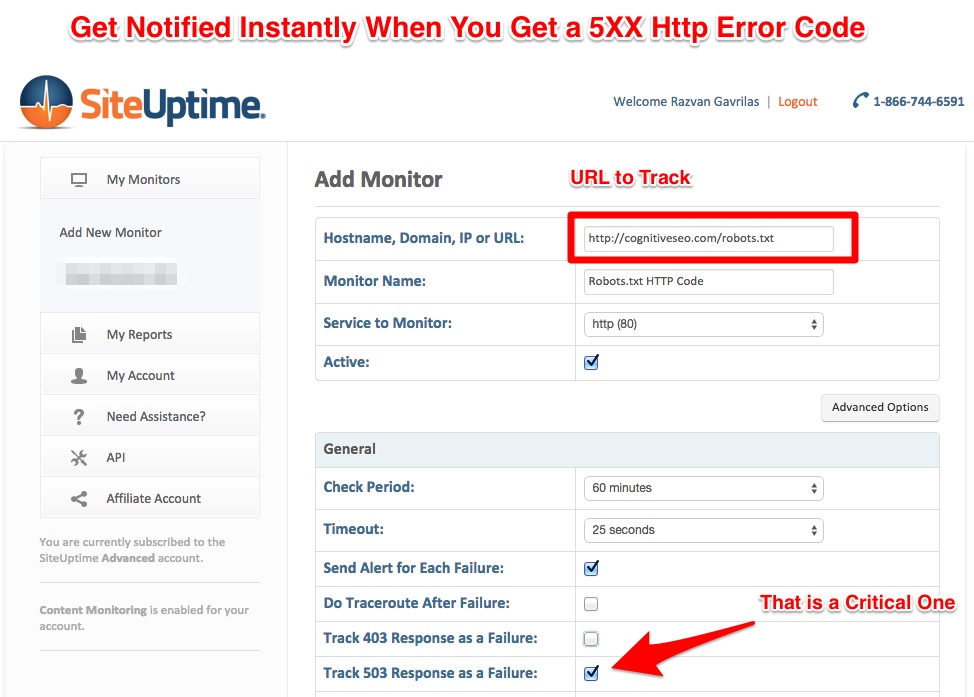

3. Pranešimai apie HTML klaidas – nemokamas ir mokamas įrankis

Kad darant „robots.txt“ failą nebūtų šaudoma į koją, turėtų būti rodomi tik šie „HTML“ klaidų kodai.

-

200 kodas iš esmės reiškia, kad puslapis buvo rastas ir perskaitytas;

-

403 ir 404 kodai, o tai reiškia, kad puslapis nerastas, todėl robotai manys, kad neturite failo robots.txt. Tai paskatins robotus tikrinti visą jūsų svetainę ir atitinkamai ją indeksuoti.

„ SiteUptime“ įrankis periodiškai tikrina jūsų robots.txt URL ir gali iškart pranešti, jei jis susiduria su nepageidaujamomis klaidomis. Kritinė klaida, kurią norite stebėti, yra 503.

503 klaida rodo, kad serverio pusėje yra klaida ir, jei robotas su ja susiduria, jūsų svetainė apskritai nebus tikrinama.

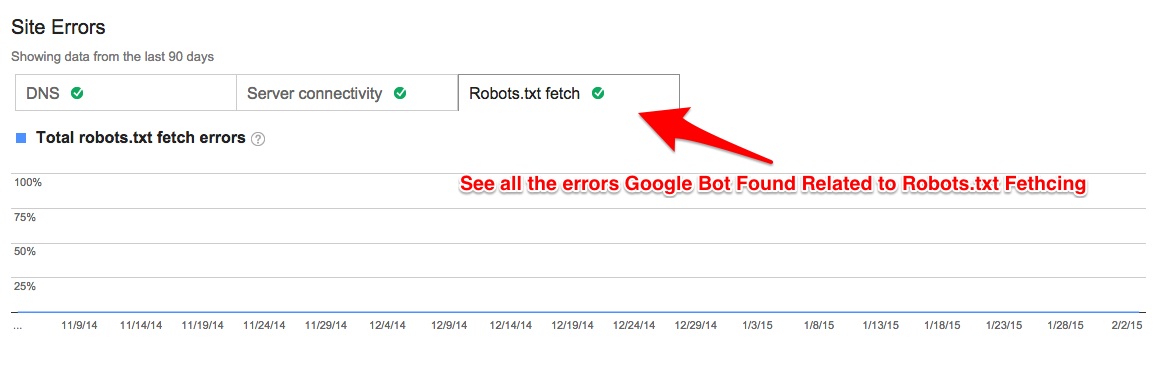

„Google Webmaster Tools“ taip pat nuolat stebi ir rodo kiekvieno roboto failo gavimo laiko juostą. Diagramoje „Google“ pateikia klaidas, kurias rado skaitydama failą; rekomenduojame kartą į jį pažiūrėti, kad patikrintumėte, ar jame nėra kitų klaidų, išskyrus išvardytas anksčiau. Kaip matome žemiau, „Google“ žiniatinklio valdytojo įrankiai pateikia diagramą, kurioje nurodomas dažnis, kuriuo „Googlebot“ atnešė failą „robots.txt“, taip pat visos klaidos, su kuriomis jis susidūrė jį gaunant.

Kritinės, tačiau dažnos klaidos

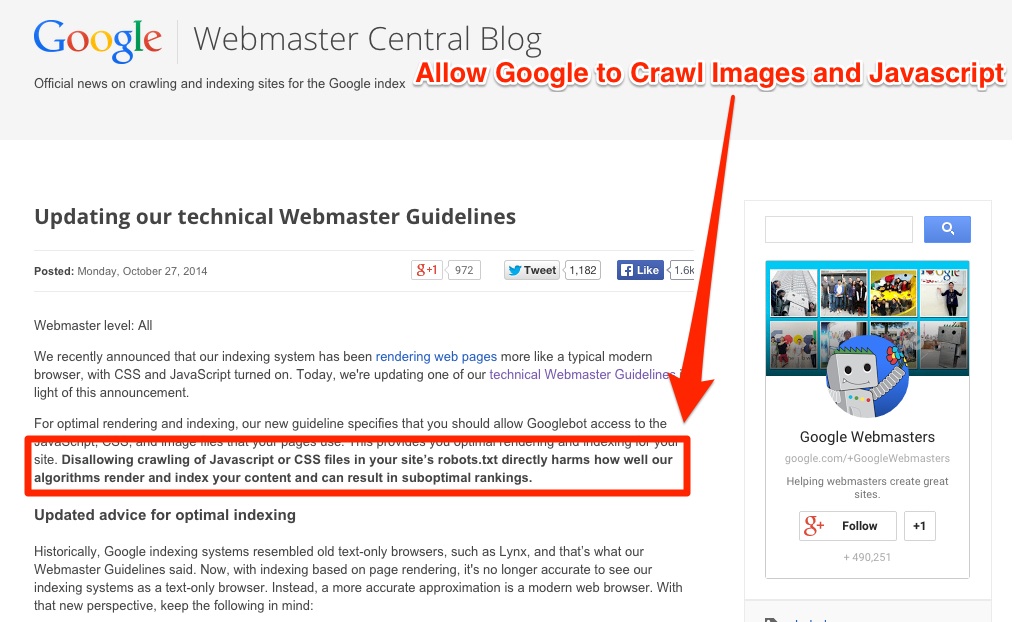

1. CSS ar vaizdo failų blokavimas iš „Google“ tikrinimo

Praėjusiais metais spalio mėnesį „ Google“ pareiškė, kad CSS, „Javascript“ ir net vaizdų neleidimas ( apie tai parašėme įdomų straipsnį ) yra svarbus jūsų svetainės reitingui . „Google“ algoritmas tampa vis geresnis ir dabar sugeba perskaityti jūsų svetainės CSS ir JS kodą ir padaryti išvadas, kiek turinys naudingas vartotojui. Užblokavus šį turinį robotų faile, galite pakenkti ir neleisite užimti tokią aukštą poziciją, kokią turėtumėte turbūt.

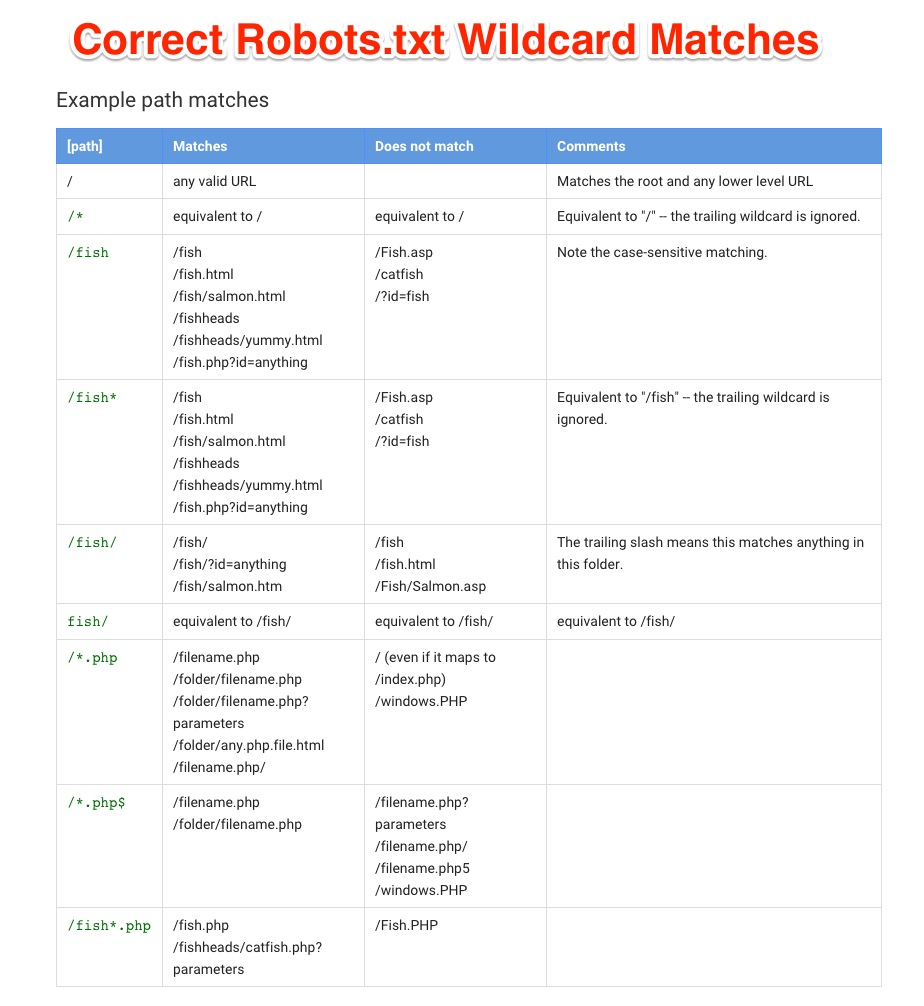

2. Neteisingas pakaitinių simbolių naudojimas gali pašalinti jūsų svetainę

Pakaitalai, tokie simboliai kaip „*“ ir „$“, yra tinkama parinktis blokuoti URL partijas, kurios, jūsų manymu, neturi reikšmės paieškos varikliams. Dauguma didžiųjų paieškos sistemų robotų stebi ir jiems paklūsta naudodami jį robots.txt faile. Tai taip pat yra geras būdas užblokuoti prieigą prie kai kurių giliųjų URL nenurodant jų visų robotų faile.

Taigi, jei norite užblokuoti, tarkime, URL, kurių plėtinys yra PDF, labai gerai galite parašyti eilutę savo robotų faile naudodami „User-agent“: „googlebot“

Neleisti: /*.pdf$

* Pakaitos simbolis rodo visas galimas nuorodas, kurios baigiasi .pdf, o $ uždaro plėtinį. $ Pakaitos simbolis plėtinio pabaigoje nurodo robotams, kad tik URL, kurie baigiasi pdf, neturėtų būti tikrinami, o bet kuris kitas URL, kuriame yra „pdf“, turėtų būti tikrinamas (pvz., Pdf.txt).

Ekrano nuotrauka paimta iš developers.google.com

* Pastaba: kaip ir bet kuris kitas URL, robots.txt failas skiriamas nuo didžiųjų ir mažųjų raidžių, todėl rašydami failą į tai atsižvelgkite.

Kiti „Robots.txt“ naudojimo atvejai

Nuo pat pirmo pasirodymo robots.txt failas buvo žinomas kaip kai kurie kiti žiniatinklio valdytojai. Pažvelkime į kitus naudingus būdus, kaip kas nors galėtų pasinaudoti rinkmena.

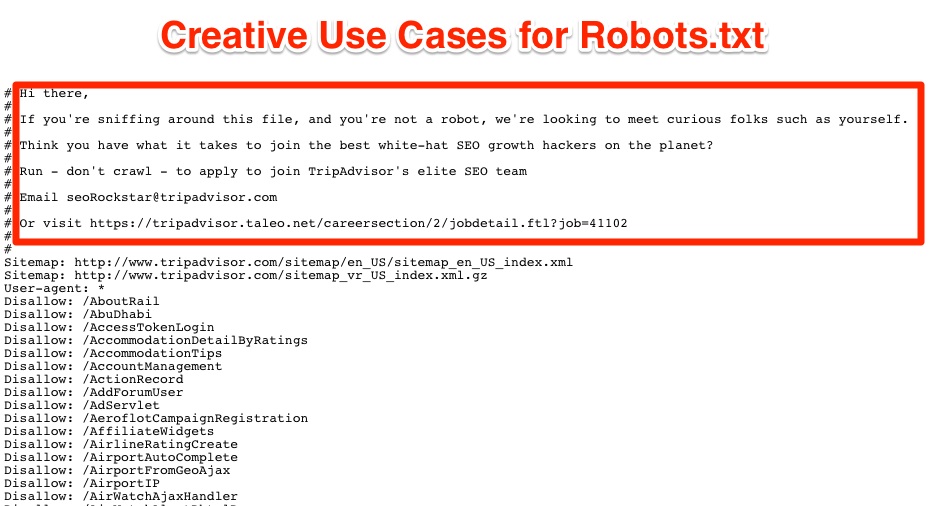

1. Išsinuomokite nuostabius geekus

„Tripadvisor.com“ failas robotos.txt paverstas paslėptu įdarbinimo failu. Tai įdomus būdas iš grupės išfiltruoti tik „geekiest“ ir rasti tiksliai tinkamus žmones jūsų įmonei. Pripažinkime, tikimasi, kad šiais laikais žmonėms, besidomintiems jūsų įmone, prireiks papildomo laiko apie tai sužinoti, tačiau žmonės, kurie net ieško paslėptų pranešimų jūsų robots.txt faile, yra nuostabūs.

2. Neleiskite, kad svetainė būtų užkalta tikrintuvų

Kitas roboto failo naudojimas yra neleisti šmaikštiems tikrintojams valgyti viso pralaidumo. Komandinės eilutės tikrinimo delsimas gali būti naudingas, jei jūsų svetainėje yra daug puslapių. Pvz., Jei jūsų svetainėje yra apie 1000 puslapių, žiniatinklio tikrintuvas gali tikrinti visą jūsų svetainę per kelias minutes. Komandos eilutės pateikimas „Tikrinimo uždelsimas: 30“ liepia jiems tai padaryti šiek tiek lengviau, naudoti mažiau išteklių ir jūsų svetainę tikrins per kelias valandas, o ne kelias minutes.

Mes tikrai nerekomenduojame to naudoti, nes „Google“ iš tikrųjų neatsižvelgia į nuskaitymo delsos komandą, nes „Google Webmaster Tools“ turi įmontuotą tikrinimo greičio derinimo funkciją. „Crawl-delay“ funkcijos naudojimas geriausiai tinka kitiems robotams, pvz., „Ask“, „Yandex“ ir „Bing“.

3. Neleisti konfidencialios informacijos

Konfidencialios informacijos neleisti yra šiek tiek dviašmenis kardas. Puiku neleisti „Google“ pasiekti konfidencialios informacijos ir rodyti ją fragmentuose žmonėms, kuriems nenorite prieigos prie jos. Tačiau daugiausia todėl, kad ne visi robotai paklūsta komandoms robots.txt, kai kurie tikrintuvai vis tiek gali prieiti prie jos. Panašiai, jei žmogus, turėdamas galvoje neteisingus ketinimus, ieškos jūsų robots.txt failo, jis galės greitai rasti svetainės sritis, kuriose yra brangios informacijos. Mūsų patarimas yra tai naudoti protingai ir ypač atidžiai žiūrėti į ten pateikiamą informaciją ir atminti, kad prie failo robots.txt gali naudotis ne tik robotai.

Prisiregistruokite gauti išskirtinius SEO patarimus ir atvejų tyrimus

Gaukite nemokamų SEO strategijų, kurias galite naudoti norėdami padidinti savo svetainės srautą ir padidinti konversijų skaičių.

Išvada

Tai puikus atvejis, kai „su dideliu galingumu kyla didesnė atsakomybė“. Gebėjimas nukreipti „Googlebot“ naudojant gerai parašytą roboto failą yra viliojantis. Kaip nurodyta žemiau, gerai parašyto roboto failo privalumai yra dideli, greitesnis tikrinimo greitis, tikrintojams nėra nenaudingo turinio ir net darbo vietų įdarbinimo pranešimai. Tiesiog nepamirškite, kad viena maža klaida gali padaryti daug žalos. Kai darote robotų failą, turite aiškų vaizdą apie kelią, kurį robotai eina jūsų svetainėje, neleiskite jų naudoti tam tikrose jūsų svetainės dalyse ir nesuklyskite užblokuodami svarbias turinio sritis. Taip pat reikia atsiminti faktą, kad failas robots.txt nėra teisėtas globėjas, robotai neprivalo jam paklusti, o kai kurie robotai ir tikrintuvai net nesivargina ieškoti failo ir tiesiog tikrina visą jūsų svetainę.